霍金的遺願清單:離開地球和警惕人工智能

- 更新時間:2018-03-14 14:20來源:網絡作者:@nanncy人氣:243679

輪椅上的斯蒂芬·霍金終於離開了地球,可以和愛因斯坦、牛頓他們一起打打牌了。

在過去的二十年裡,霍金是明星,除了繼續探索宇宙理論,他也出現在各種場合,為所有關切人類命運的主題發聲。而在他去世前的這幾年中,霍金最關註的話題就是:離開地球和警惕人工智能。

現在我們就梳理下霍金通過各種渠道談論這兩個話題的言論。

關於離開地球,早在2011年霍金在接受美國視頻共享網站BigThink訪談時就稱地球將在兩百年內毀滅,人類要想活命只能移民外星球。

2017年11月5日,霍金通過視頻指出了人類移民太空的原因所在:一個原因是,對我們來說,地球變得太小了。在過去二百年中,人口增長率是指數級的,即每年人口以相同比例增長。目前這一數值約為1.9%。 這聽起來可能不是很多,但它意味著,每四十年世界人口就會翻一番。 2022年,我將慶祝自己80歲的生日,而在我人生的這段歷程中,世界人口比我出生時膨脹了四倍。這樣的指數增長不能持續到下個千年。 到2600年,世界將擁擠得 “摩肩擦踵”,電力消耗將讓地球變成“熾熱”的火球。這是岌岌可危的。然而我是個樂觀主義者,我相信我們可以避免這樣的世界末日,而最好的方法就是移民到太空,探索人類在其他星球上生活的可能。

而在2017年7月,霍金就痛批美國總統特朗普退出氣候問題《巴黎協定》的決定,可能將導致不可逆轉的氣候變化,警告稱此舉或將讓地球變成一個金星一樣的溫室星球。霍金在接受BBC專訪時表示,我們正在接近全球變暖不可逆轉的臨界點,特朗普的決定可能將地球推過這個臨界點,變成像金星一樣的星球,溫度高達250度,並且下著硫酸雨。

也是在2017年6月播放的紀錄片《遠征新地球》(Expedition New Earth)中,霍金說,在未來一百年內,人類為生存必須離開地球,在太空尋求新家。

離開地球,霍金也不是光嘴皮子嚇唬嚇唬大家,2016年4月12日在紐約宣佈啟動“突破射星”計劃,將同俄羅斯商人尤里·米爾納(Yuri Milner),以及美國社交網站面簿創始人兼總裁紮克伯格(Mark Zuckerberg)合作建造能以五分之一光速飛往比鄰星的微型星際飛船。

除了地球即將面臨的各種風險,霍金更關切人類正在創造一個毀滅自己的怪物:人工智能(AI)。

2017年3月,霍金在接受英國《泰晤士報》採訪時再次發出警告,“人類需要控制以人工智能為代表的新興科技,以防止它們在未來可能對人類生存帶來的毀滅性威脅。”他還說,“自從人類文明開始以來,侵略便一直存在,往往出現在相對具有生存能力優勢的不同群體之間,而未來人工智能進一步發展便可能具備這種‘優勢’”,霍金解釋自己的警告時說道,“他們本身也是生根於達爾文的進化論之中。因此人類需要利用邏輯和理性去控制未來可能發生的威脅。”

2016年10月19日,劍橋大學“萊弗休姆的未來智能中心(LCFI)”正式投入使用。霍金在慶祝典禮上發表了演講。霍金在演講中批評了人工智能的無節制發展,他認為,人工智能技術的確有希望帶來巨大的福利,比如根除疾病和貧困,但是它同樣也可能帶來危險,比如強大的自主式武器,或者幫助少數人壓迫多數人。“我們花了大量的時間來學習歷史。”霍金說,“讓我們面對現實,大部分的歷史是愚蠢的。所以對於那些學習未來智能的人應該表示歡迎。” “我們生活的每一個方面都會改變。總之,創造AI的成功可能是我們文明歷史上最大的事件。”霍金說。

2016年1月26日和2月2日在BBC電臺第四頻道播出霍金瑞思系列演講(Reith Lectures),在演講中他直言,科學技術的進一步發展會惹出更多的新麻煩。同樣在這個演講中,霍金依舊認為科技進步是人類的新威脅。他甚至提及若人類最終得以在其他星球建立家園,或許還能幸存下來。

“盡管地球在某一年遭受滅頂之災的可能性很低,但隨著時間的推移,在未來幾千或幾萬年,這會是可以預見的事情。那時,我們應該已經進入太空、住到其他星球上。所以地球上的毀滅並不意味著人類的終結。”“然而,至少在未來數百年裡我們還無法在太空世界建起人類的地盤。所以我們現在必須非常小心。”

2015年,霍金曾聯合思想家喬姆斯基馬斯克等數千名知識分子發表聯名公開信中警告:必須取締“機器人殺手”的研發和應用,人工智能方面的軍備競賽可能是人類的災難,它將助長戰爭和恐怖主義,加劇世界動蕩局勢。

這封公開信由未來生活研究所(Future of Life Institute)發起,這個團體致力於緩解“人類面臨的生存風險”,警告人們啟動“人工智能軍備競賽”的危險。公開信中談到“人工智能技術已經達到了這樣一個地步:如果沒有法律限制,那麽這種系統的部署在未來幾年中就可以實現,並不需要等待幾十年。”

而早在2014年12月,霍金接受英國廣播公司(BBC)採訪時就明確表示:“制造能夠思考的機器無疑是對人類自身存在的巨大威脅。當人工智能發展完全,就將是人類的末日。”

霍金也許對人類和科技的未來是悲觀的,他並不信任人類真的能控制科技這個怪物,但令人諷刺的是,一旦人類用科技毀掉了這個星球,他所能仰賴的也只有科技能幫這個種族在外星球繼續繁衍。

來源:網易新聞

- 凡本網註明"来源:華發網繁體版的所有作品,版權均屬於華發網繁體版,轉載請必須註明來自華發網繁體版,https://china168.org。違反者本網將追究相關法律責任。

- 本網轉載並註明自其它來源的作品,目的在於傳遞更多信息,並不代表本網贊同其觀點或證實其內容的真實性,不承擔此類作品侵權行為的直接責任及連帶責任。其他媒體、網站或個人從本網轉載時,必須保留本網註明的作品來源,並自負版權等法律責任。

- 如涉及作品內容、版權等問題,請在作品發表之日起一周內與本網聯系,否則視為放棄相關權利。

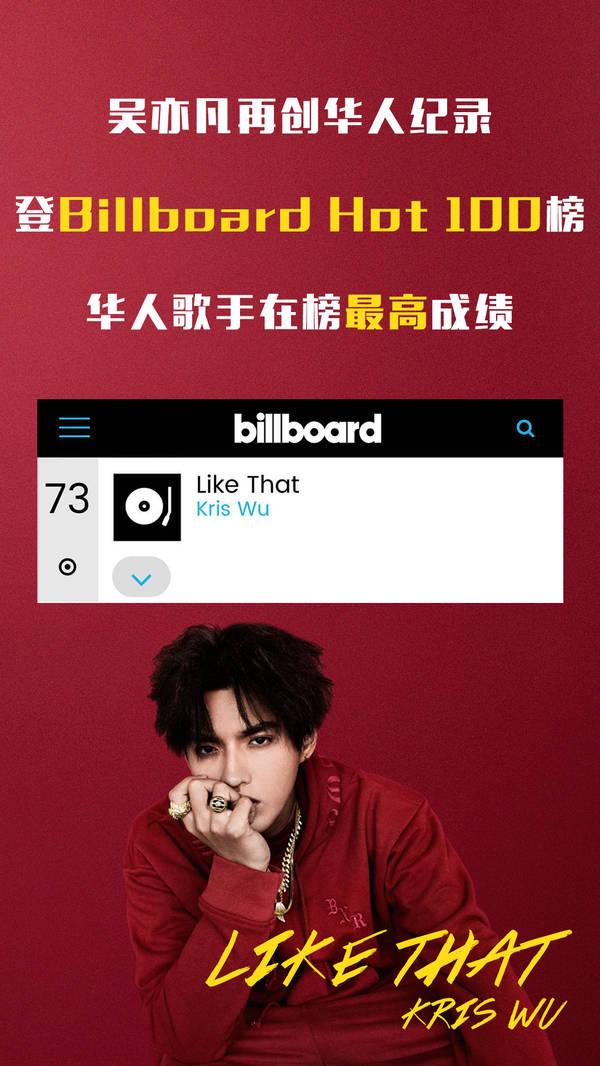

- 1想成為音樂界的成龍 吳亦凡:讓全世界聽到華人音樂

6月2日下午,有網友曬出吳亦凡做客美國音樂節目直播的視頻,視頻中被問及如何縮小東西方嘻哈的差距,吳亦凡稱自己想做東西方嘻哈之間的橋樑,並坦言想當音樂界的成龍。 [詳細]

- 2俞飛鴻的美,是“不止於美”

害怕變老,似乎是很多人的心病。 變老意味著隨著年齡增長,其他屬性會發生各種變化。人們的臉上會長皺紋、皮膚變得更加鬆弛、膠原蛋白也不斷地流失,甚至體質也一年不如一年。[詳細]

- 3專訪關曉彤:跟張藝謀學習很多,導演是個溫柔的人

關曉彤在張藝謀的新片《影》當中飾演了一個叛逆有性格的公主,這是她以前沒有嘗試過的角色,也是第一次和張藝謀合作。即將開始讀大三的關曉彤對自己能加入到張藝謀的劇組中倍感驕傲,她毫不掩飾地表達了對導演的尊敬,連連說從導演身上學到了很多東西。而她對[詳細]

- 4林妙可穿衣又踩雷,硬是從19歲穿成了29歲,看來該請造型師了

今年19歲的林妙可,因在2008年北京奧運會上的亮相一夜爆紅,成為了紅極一時的童星。隨著時光的流逝,童星林妙可也已經長大,可她卻並不像楊紫、關曉彤一樣順利晉升花旦行列,反而人們更多是把關註點放在了其“與年齡極不相符”的衣品上面……[詳細]

- 5張愛玲與港大

才女張愛玲,文筆細膩,她的小說獨樹一幟,令人有深入骨髓的感覺,連大導演李安也是她的超級粉絲,將其同名小說《色,戒》改編成電影,搬到大銀幕,且頻頻獲獎。[詳細]

- 6解開心結?周傑倫曬休比都嘩排練照:仿佛回到過去

搜狐娛樂訊 吳宗憲將於28日在台北小巨蛋開唱,休比都嘩19日合體彩排,一連演唱三首歌,當年替團體寫下《世界末日》的周傑倫,曾因“喜帖事件”和吳宗憲鬧僵,但幾年後訪問,周傑倫曾多次提到吳宗憲當年的教導,19日更在社交網站上寫下:“妳們的合體又讓我仿佛[詳細]

- 7專訪《炮灰攻略》餘玥:演百合很精分被嚴禹豪撩會心動

由餘玥、嚴禹豪、趙誠宇等主演的《炮灰攻略》正在搜狐視頻熱播。該劇改編自莞爾同名人氣網路小說《炮灰攻略》,講述了元氣少女百合意外進入懸浮時空的“萬卷書館”,從此開啟穿越“三千小說世界”助力炮灰角色人生逆襲的故事。[詳細]

- 8專訪昆淩:周董有空就會陪通告,現在不會想女兒到哭了

昆淩在電影《摩天營救》裏出現的時候,很多人都沒反應過來,有好多觀眾是看過了好幾分鐘才反應過來——剛才那個一身黑衣、身手利落的“女殺手”是昆淩嗎?沒錯真的是她。與在綜藝節目和接拍照片中出現的活潑、溫婉的形象截然不同,昆淩這次演了一個打女。這幾[詳細]

- 941歲陳數vs44歲董卿:她們的高級美從何而來?

提起娛樂圈中的知性女人,很多人腦海中浮現的往往是董卿、楊瀾的名字,她們舉止得體氣度恬淡,總有一種讓人如沐春風的感覺; 很少有女性能夠超越董卿楊瀾,但卻有一個女人毫不遜色於她們,她就是陳數。[詳細]

- 10廖凡:演技沒法分高低,每個人在一瞬間都是好演員

9月21日,賈樟柯新作《江湖兒女》上映,廖凡在裏面演了一個北方小縣城裏的江湖大哥斌哥,隨著時代的變遷,處境和心境都發生了很大的變化。雖然角色沒有趙濤演的“大女主”巧巧光彩奪目,但作為搭檔,廖凡的演技沒得說,會讓人感嘆不愧是影帝。 [詳細]

- 11Banksy罕見作品現倫敦畫展

據新加坡《海峽時報》報道:英國街頭藝術家Banksy因其神秘的街頭塗鴉作品聞名全球,曾為Banksy經理人的拉扎里迪斯7月11日至下月25日在倫敦舉行免費展覽,讓觀眾一睹從未在街頭出現過的Banksy的作品。 [詳細]

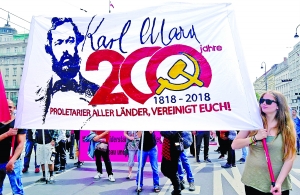

- 12馬克思誕辰200周年,德國掀起“馬克思熱”

據中新社報道,今年五月五日是卡爾 · 馬克思誕辰二百周年。四日,北京將舉行紀念馬克思誕辰二百周年大會,中共中央總書記、國家主席、中央軍委主席習近平將出席大會並發表重要講話。在這一重要紀念日前夕,記者在馬克思故土——德國十分直觀地感受到不斷升溫[詳細]

- 和氣生財6/李家超:推廣禮貌服務 提升香港魅力

- 行政長官李家超將赴北京述職

- 吸引力足/寧德時代來港落戶 設國際總部及研發中心

- 免簽生效 到中國經商旅遊更方便

- 特區政府斥美打「法案牌」干預港事務

- 高鐵載客量超越疫前 短途增幅大

- 民進黨處心積慮搞「台獨教育」

- 市區「輕微僭建」 研申報後暫緩執法

- 情牽兩岸/創業台青深耕國漫IP 傳播中華文化

- 施政報告前瞻/設中醫藥專員 建數碼化中藥平台

- 兩岸京劇一脈傳 好戲連「台」見情深

- 投資信心提振 恒指連升六日共千點